人机交互如何重塑景观感知?多源数据、多通道与情感计算深度解析

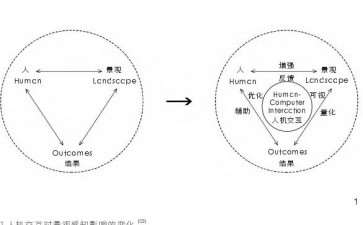

人机交互具有多源数据采集、多通道交互、实时移动计算、情感判断反馈4个方面的特征,这为景观感知体验带来了更多的可能性。总体来看,人机交互对景观感知的影响体现在4个方面,即多源数据拓展空间信息范围(感知维度)、多通道交互增强感官体验(感知方式)、实时计算强化动态响应过程(感知过程)、情感计算触发情感反馈(感知效果)。

3.1 感知维度:多源数据拓展空间信息范围

人机交互具有多源数据采集的特征,通过监测不同类型数据的传感器[29]、识别人行为活动的摄像头、测量生理指标的测量仪、获取地理信息数据的无人机[30]和地理信息系统(GIS)[31]等数据采集媒介的广泛使用,可以多途径、多维度获取以往难以获得的数据信息,通过计算机算法处理,不仅可以帮助人们摆脱只能依靠身体感知的局限,拓展人对空间信息的感知方式和感知范围,还可以帮助人们更好地认知生物特征或者自然过程的复杂性,理解自然和环境的运转模式,并能直接进行互动[32]。

在人机交互的支持下,通过传感器等设备监测微气候、植物、水文、空气质量等环境要素的变化数据,可以将空间中以往人难以感知或者不可见的微小变化,通过机器将变化过程和结果进行放大或者转化,以可视化的方式呈现给公众[33]。

人机交互可以拓展人们对生物的感知维度,如植物学研究表明,植物可以表现出智能性,只是其与人类和动物所具有的机制不同,且时间跨度更长[34]。英国伦敦大学学院(UCL)的交互建筑(interactive architecture)实验室在reEarth项目中向人们展示了植物对环境的自主感知能力,在一个球形交互装置Hortum machina, B中安装光照传感器和插入式电极,以植物对光照的微小生理变化反应,驱动Hortum machina, B的自主旋转移动[35](图3)。

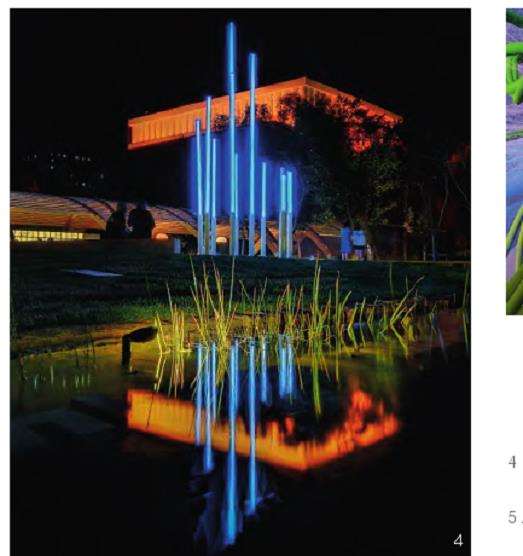

北京林业大学园林学院蔡凌豪老师在《光之螺旋》交互景观中,将10根由单片机控制的光柱,通过物联网连接到校园里的银杏(Ginkgo biloba)、鹅掌楸(Liriodendron chinense)、白皮松(Pinus bungeana)等10棵古树上,树上的水分传感器会感知植物维管束中的水分含量,该水分含量数据会控制光柱的灯光颜色变化,当植物水分充足时灯光呈现冷色,若水分减少灯光向暖色渐变,最终变为红色,灯光颜色的变化犹如植物实时的心电图,将植物中细微的变化转变成可见的景观,艺术性地表达了自然万物的生命节律和脉动[36](图4)。

人机交互还可以拓展人们对环境因素的感知维度,如Swatek和他的团队研发的SmartSolarFlower交互景观可以时刻向人们呈现太阳的位置变化,其模仿向日葵(Helianthus annuus)的原理,利用GPS数据和光照传感器,可以实时跟踪太阳的方位和角度,并通过内置的双轴跟踪系统,确保其始终与太阳保持90°的直射角度[37]。北京林业大学学研中心景观的交互装置,利用由PM2.5传感器和Arduino单片机组成的控制系统,监测空气中PM2.5的浓度变化,并将其通过玻璃艺术装置的颜色变化呈现给公众[38]。

除了拓展物理空间中的信息感知,采集的数据信息可以被转化为可视化的虚拟场景,借助AR技术叠加在物理空间上,丰富和拓展人们对虚拟空间的信息感知。谢菲尔德大学Haynes等[39]运用AR技术开发以移动设备为载体的景观雨洪模拟系统,该系统通过在真实场景中叠加雨洪数据信息,帮助人们更好地感知景观环境变化并及时做出应对。北京古北水镇的AR历史地图,借助手机、Ipad等设备,利用AR技术在真实的明信片上“叠加”虚拟的历史生活场景,创造跨越时空的空间场景连接。人机交互的多源数据采集特征打破了物理空间的限制,建立了景观中物理空间与虚拟空间之间的关联。

3.2 感知方式:多通道交互增强感官体验

多通道(multimodal)交互即利用人的多种动作通道和感觉通道(如表情、手势、语音、动作、视线等)输入信息,与计算机环境以非精确、并行的方式进行交互[40]。在人机交互中,多通道交互实现了景观感知深度的增强,这包括了视觉、听觉、触觉的感知增强,以及多感官交融下的感知增强。多通道交互是实现自然人机交互的重要途径,其在自然交互和移动交互方面,相较于传统的单一通道交互方式有着更广泛的应用潜力,能够扩大用户输入信息的带宽,提高用户输入的效率,促使人们能够按其熟悉的方式进行人机通信。人机交互下的多通道交互包括信息输入与输出两大核心过程,持续革新升级的交互技术与不断探索优化的科研经验始终在助力这两大过程的发展。

在输入方面,基于深度神经网络模型的单通道输入如人机对话、机器翻译、目标识别、语音识别、手势检测与跟踪、人体检测与跟踪等性能得到快速提升,如超大规模深度卷积神经网络(convolution neural network, CNN)在图像目标识别领域的辨识水平已经超过普通人类的水平[41]。协同现今交互技术的发展步调,多通道交互也逐步向融合视觉、语音、语义、动作等的多模态计算发展。

目前基于机器学习或者统计方法的多通道信息融合计算模型主要包括神经网络模型、Bayes决策模型和基于图模型的信息融合。谷歌公司的开发者通过神经网络模型试图建立一个统一的深度学习模型,保证它在性能没有明显损失的情况下,能够有效地完成不同数据模态、不同领域下的多类型任务[42],以精确且全面地捕捉人的意向。在语音交互方面,中国科学院自动化研究所的学者们通过摄像头、麦克风、体感捕捉设备等工具,获取人的多模态行为信息,采用多虚拟人对话管理机制和混合主导式对话策略,对手势、语音、情感、姿势等多模态信息进行分析融合,以理解人的意图并自动生成对话语言[43]。

在输出方面,多通道交互模式可根据人的需求综合使用多种输出通道,并进行多通道融合,形成多设备协同和跨设备场景迁移的新型人机交互模式和产品形态[44],有效提升人机交互过程中的感官体验与沉浸感。一方面来自数据的“包裹”,大量的、丰富的、多维度的数据可以让使用者瞬时获得理想的信息和体验;另一方面来自光电媒介、显像媒介、声音媒介、可触媒介等媒介传播载体的增强,以及各媒介之间表现出的高度复合性,使输出形式更加多样化和复杂化。正如徐跃家等[45]所言,数字技术给人们带来了前所未有的综合感知体验,就连一个小小的手机都能具有听觉、视觉、触觉等输出方式,实现从生理到心理的多感同步。

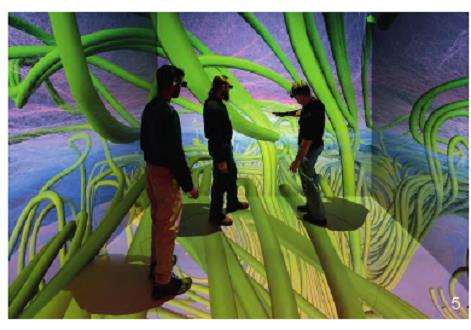

近10年高速发展的VR技术,更是让人“真实地进入”虚拟空间中,配合触觉、嗅觉、听觉等多通道感官交互,获得身临其境的沉浸式体验。美国麻省理工学院Media实验室的城市科学(city science)研究小组在一次针对世界女性生活的策展中,通过多面屏幕、高清投影和灯光设计等多种媒介,将动态影像与空间中心的城市模型相结合,使人们沉浸式地以他人的视角体验世界[46]。弗吉尼亚理工大学的高级研究计算(advanced research computing, ARC)实验室通过多面屏幕、高清投影与VR操控结合的方式,使人们能够沉浸式地体验虚拟场景并自由地操控场景变化[47](图5)。

Teamla团队的作品《在人们聚集的岩石上,注入水粒子的世界》(Universe of Water Particles on a Rock Where People Gather)利用互动投影技术,在虚拟的三维空间中立体再现瀑布沿岩石下落的场景,作品通过实时计算人与水粒子之间相互作用产生的运动轨迹,描绘人与水形成的动态效果,同时场景中的樱花也会随人的移动逐渐绽放,形成人对景观干预的实时反馈[48]。

3.3 感知过程:实时计算强化动态响应过程

建立在实时计算上的动态响应过程是对景观感知操作性与灵活度的加成,这种动态响应主要包括人与空间环境数据间的动作性交互与心理性交互。随着信息和数字技术融入城市环境,城市成为一个无时不在、无处不在而又无形的计算环境。这种新技术带来的新城市环境,在人与机器之间建立起动态的多层次、多维度的互动和联系,并最终产生“泛在联系”(ubiquitous connection)[49]。信息网络化的链接和传递、多种设备之间的连接性和信息数据的共享性,也实现了技术(互联网技术、云计算、物联网及大数据技术等)、场景、参与者(人、物、机构、平台、行业及系统)之间的瞬间联系。

正是数据的实时计算与高速网络信号传递的发展,使得当下从技术层面加快了人机交互速度,人对空间的体验与需求能够快速地通过交互技术与景观环境连接,而无须长时间等待或人工介入。人的行为可以获得实时的动态反馈,以往被动参与景观的过程转变为主动介入,静态观赏景观的过程转变为实时互动[50],从而激发出新的行为方式。同时,在互动的过程中,人以使用者的身份参与作品并成为作品的一部分,而且人参与创作过程的不确定性又会使信息转换的呈现方式产生多样性。

Media实验室研究的触控视觉魔方(tangible view cube)能够实现以实体模型为依托的多角度景观场景模拟[51]。用户可以在实体模型中自由翻转魔方,而计算机中的景观场景渲染则会根据魔方的位置和角度做出实时改变,从而使用户能够脱离鼠标与键盘,实现更便捷的交互行为。

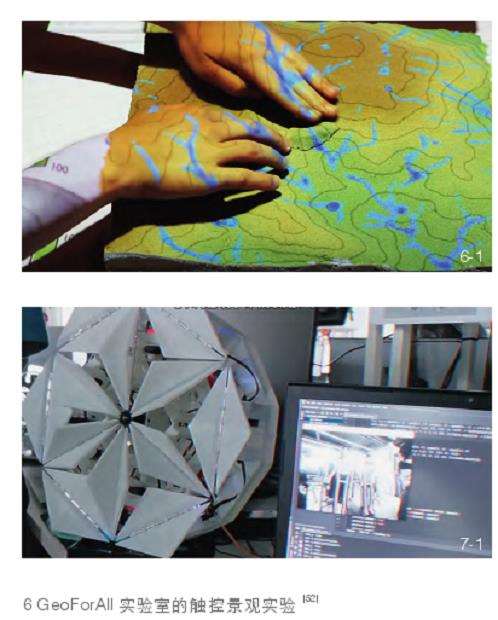

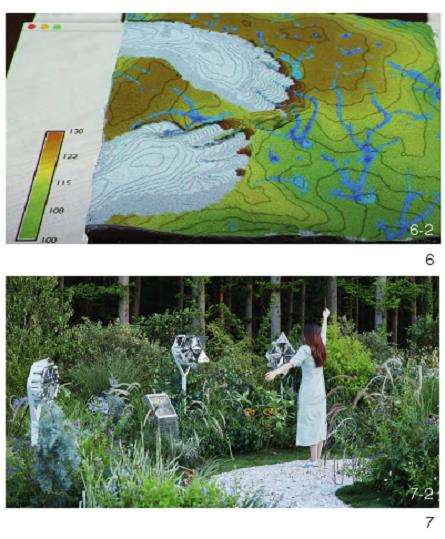

同样基于强化动态交互的目标,美国北卡罗来纳州立大学的GeoForAll实验室通过触控景观(tangible landscape)技术使人们能够通过直接操作景观模型来实时改变电子图像及相关分析数据,用户可以在实体景观模型中自由改变景观要素与形态,而这些改变将被投影捕捉并实时传输至计算机中。最终,新的数据分析与场景渲染将实时更新,从而实现用户在参与设计的同时与设计作品高效互动[52](图6)。上海交通大学数字景观实验室研发的《AI机械花》交互景观是基于AI技术构建的一种实时响应的反馈式景观。

自然界中影响花开合的主要因素是光照,而机械花则是通过人的行为控制机械花的开合,它通过距离传感器和摄像头捕捉人的距离和肢体动作,结合人物检测、动作捕捉等算法,设置4种人机交互模式来控制机械花叶片的开合幅度和方向变化,实现模拟自然植物的智能机器对人的行为的动态反馈,增强人的景观感知。同时,机械花与环境中的自然花境形成景观模糊和体验反差,重构“人—智能机器—自然”之间的互动关系,激发人们对自然的思考(图7)。

3.4 感知效果:情感计算触发情感反馈

以动态、科学的情感计算触发用户的情感反馈,是人机交互技术提升景观感知的重要手段。情感计算是指利用机器对人类情感进行感知、识别和理解,并能针对人的情感做出智能化反应,建立人和智能机器的情感交流,甚至影响人的情绪。人机情感交互是对人类情感的信息处理过程的模拟,重点是形成人和智能机器的双向情感交流,即情感从人流向智能机器,再从智能机器回流向人,实现人机“共情”或情感“交流”。这种双向性建立在情感交互的2个核心环节上,即情感识别和情感表达。

情感识别主要基于生理信号、面部表情、文字信息、肢体动作和语音符号等途径[53]。目前的识别方式通常以单模态为主,如利用面部表情图像识别人的高兴、害怕、生气、厌恶、悲伤、吃惊这6种情感状态[54],而相关研究发现多模态比单模态能够提供更多的信息,更容易对情绪进行准确判断,但现阶段多模态一般是基于面部表情、肢体动作、语音符号其中2种结合的双模态,暂时无法实现实质上的多模态,而且生理信号也很少能与以上几种模态相结合[55]。

对情绪的特征提取和分类主要通过机器学习算法和情绪判断模型,从而实现对人的情感判断,相比于早期使用支持向量机(support vector machine, SVM)进行分类,随着数据量增大,以循环神经网络(recurrent neural network, RNN)、CNN、对抗神经网络(adversarial neural network, ANN)等为代表的深度神经网络学习显示出更精准的推测潜力[56],可以更准确地理解人的情绪。如Smile就是一种通过单模态进行面部表情识别的情绪交互景观,它由识别微笑的交互站和灯管制成的笑脸组成,当交互站感应并识别到人的微笑表情时,固定在墙上的笑脸装置就会自动亮起,形成对人情感的直接反馈[57](图8)。

情感计算的最终目的是情感表达,即在情感感知的基础上,做出智能化反应。由于机器学习在情感计算方面的应用主要集中在情感分类,很少应用于智能机器的情感表现。现有智能机器的情感表现力针对性不强,不能在与人的交互过程中对情感表达进行自动调节,因此在景观场景中较难与人形成情感交流,导致大部分案例还停留在实验室研究层面,能够应用于实践中的相对较少。

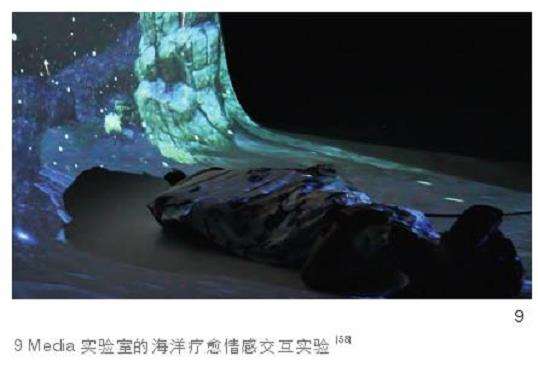

Media实验室的研究团队将VR技术与情感识别结合,营造了具有疗愈效果的情感交互场景[58]。其中,研究者运用脑电仪监测用户大脑活动,并使用医疗腕带监测他们的心率与皮电活动,这些数据将被实时转化成模拟深海生物与静谧氛围的VR画面,用户通过佩戴VR眼镜,将沉浸在这一平静的场景中直面自己身体的内部活动,而与用户相关联的虚拟场景,又反过来疗愈用户的情绪(图9)。

同样是基于对用户情感与健康的关注,华盛顿大学的研究者们运用脑电仪识别瘫痪病人的情绪与意图,再通过计算机与电子发声器将这些情绪与意图转换为动态变化的音乐。这一人机交互过程使瘫痪病人能够自由地将思绪转换为具体音符,无须双手也可以演奏音乐,病人的创作意图得以实现,心情也得到疗愈[59]。